이성구 MBC 디자인센터 차장 / 現 바이트일레븐 대표

시즌 2의 시작

<너를 만났다> 1편은 방송과 유튜브를 통해 국내를 넘어 해외 시청자들에게도 다양한 반응을 이끌어냈다. 연출을 담당한 김종우 피디와는 MBC 입사 동기였기 때문에 1편의 기획단계에서부터 ‘언리얼 엔진’을 이용한 콘텐츠 제작과 ‘제로덴서티’라는 버추얼 프로그램을 이용하는 라이브 AR 촬영 방법들을 함께 논의했었다. 1편의 콘텐츠를 제작했던 비브스튜디오스는 프로그램의 기획 의도와 VR 포트폴리오의 확보를 목표로 아주 적은 비용으로 프로젝트를 진행해 주었고, <너를 만났다>의 성공으로 VR/AR 사업을 더욱 확장할 수 있었다고 한다.

MBC와 비브스튜디오스 모두에게 아주 좋은 결과였지만, 시즌 2 제작의 경우 이미 다양한 VR 프로젝트를 진행 중인 비브스튜디오스는 다시 저예산으로 후속작품을 작업하기를 꺼려했다. 제작진과 함께 2편을 제작할 다른 VR 업체를 수소문했지만 적당한 업체를 찾을 수 없었다. <너를 만났다> 같이 기술적으로 복잡하고 까다로운 프로젝트를 진행할 만한 규모 있는 스튜디오들은 최소 7억 이상의 예산을 요구했고, 소규모 업체의 경우 모델링이나 배경 등을 따로 제작할 만한 역량은 있었지만 콘텐츠를 VR 환경에서 구현하고 AR로 라이브 촬영이 가능하게 구동할 솔루션이 없었다.

결국, 김종우 피디의 요청으로 MBC VFX 팀에서 직접 2편의 작업을 담당하게 되었다. MBC VFX 팀은 <선덕여왕>을 시작으로 <구가의서>, <W> 등 수십 편의 MBC 드라마 VFX를 제작해왔고, <두니아>와 <콜드케이스> 등의 프로젝트를 통해 언리얼 엔진에 대한 노하우도 확보된 상태였지만, 소수의 인원이 <카이로스>, <나를 사랑한 스파이> 등의 프로젝트를 동시에 진행 중이었기 때문에 <너를 만났다> 시즌 2를 직접 제작하기에는 부담이 컷던 것이 사실이다.

콘텐츠 시나리오와 배경 작업

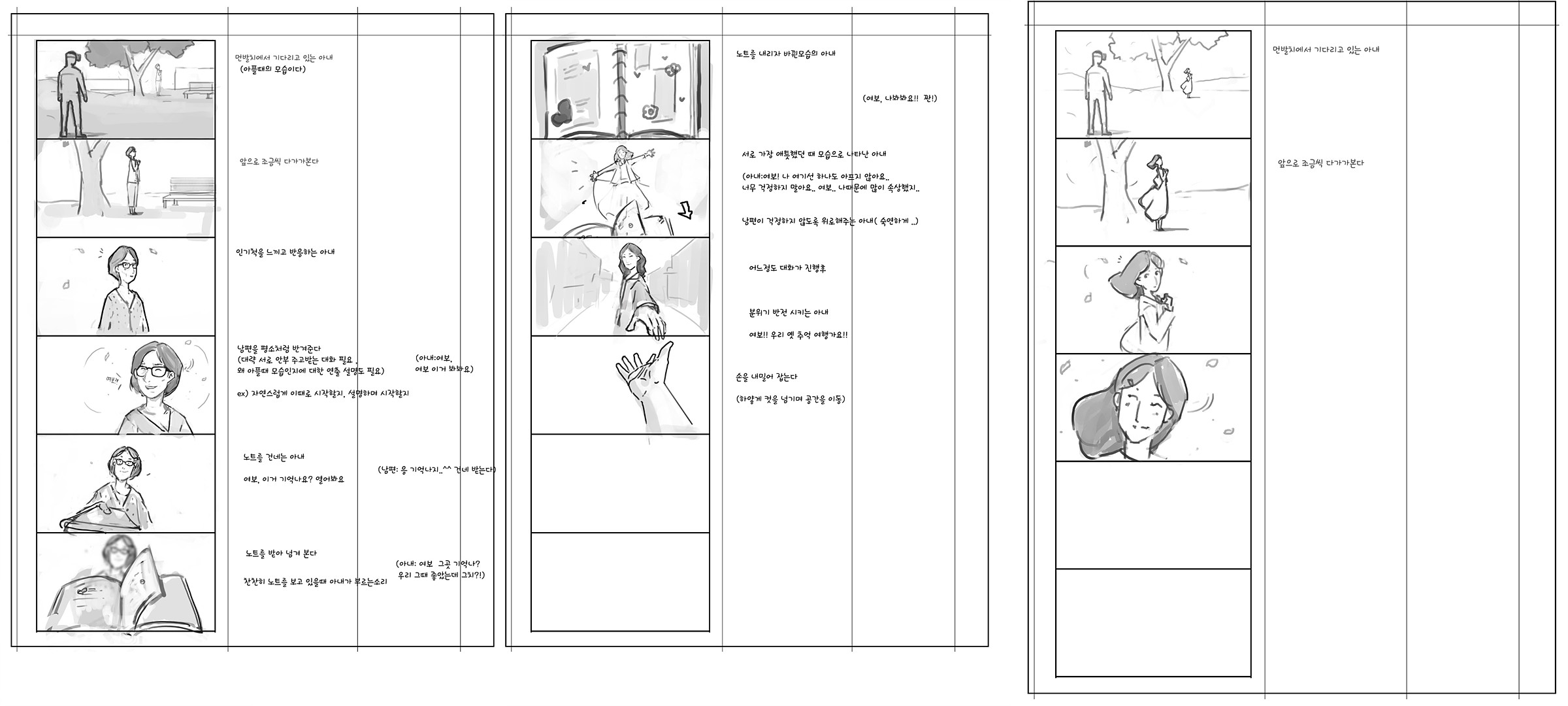

연출진은 시즌 2의 부제를 ‘로망스’ 정하고 서로를 무척이나 아꼈던 부부의 이야기를 최대한 로맨틱하게 담아내고 싶어 했다. 제작진의 아이디어가 계속해서 변경되었기 때문에 전체 스토리도 여러 번 수정이 되었지만 어떤 장소에서 남편 김정수 씨가 고인이 된 성지혜 씨를 만날지가 오랫동안 논의되었다. 오대산 월정사의 숲속은 평소 고인이 가족들과 자주 방문했던 장소이기 때문에 쉽게 장소를 확정할 수 있었지만 연출진은 오대산 외에 별도의 공간에서의 이벤트를 원했고 긴 논의 끝에 가족들이 오랫동안 살았던 파주의 아파트를 제작하기로 정했다.

파주의 아파트는 현재 다른 가족이 살고 있었고, 인테리어도 다 바뀌었기 때문에 얼마 안 되는 사진과 가족이 방송에 출연했던 옛 비디오 자료만으로 공간을 재현해야 하는 어려움이 있었다. 추리소설의 범인을 유추하는 것처럼 사진들을 분석하며 조금씩 파주집의 공간을 만들어나갔다. 연출진은 남편분이 지혜 씨를 만나기 전까지는 체험자가 자유롭게 아파트를 돌아다니며 옛 공간을 추억하기를 바랐기 때문에 만남의 장소인 거실 외에도 부엌이나 베란다 등의 디테일에 신경 써야만 했다. 아파트라는 협소한 공간은 촬영에도 여러 문제를 야기했는데 아파트의 벽과 낮은 천장 때문에 크레인으로 잡는 풀샷을 벽과 천장이 가로막았고 크레인 카메라와 연동된 컴퓨터에는 각도에 따라 벽과 천장을 투명하게 만드는 별도의 작업이 필요했다. 파주집을 제작하는 과정은 길고 힘들었지만, 시연 당일 파주집을 보며 반가워하는 아이들의 모습을 보며 가족들에게 엄마와 함께 생활했던 공간을 보여주고 싶어 했던 연출진의 의도가 틀리지 않았음을 알 수 있었다.

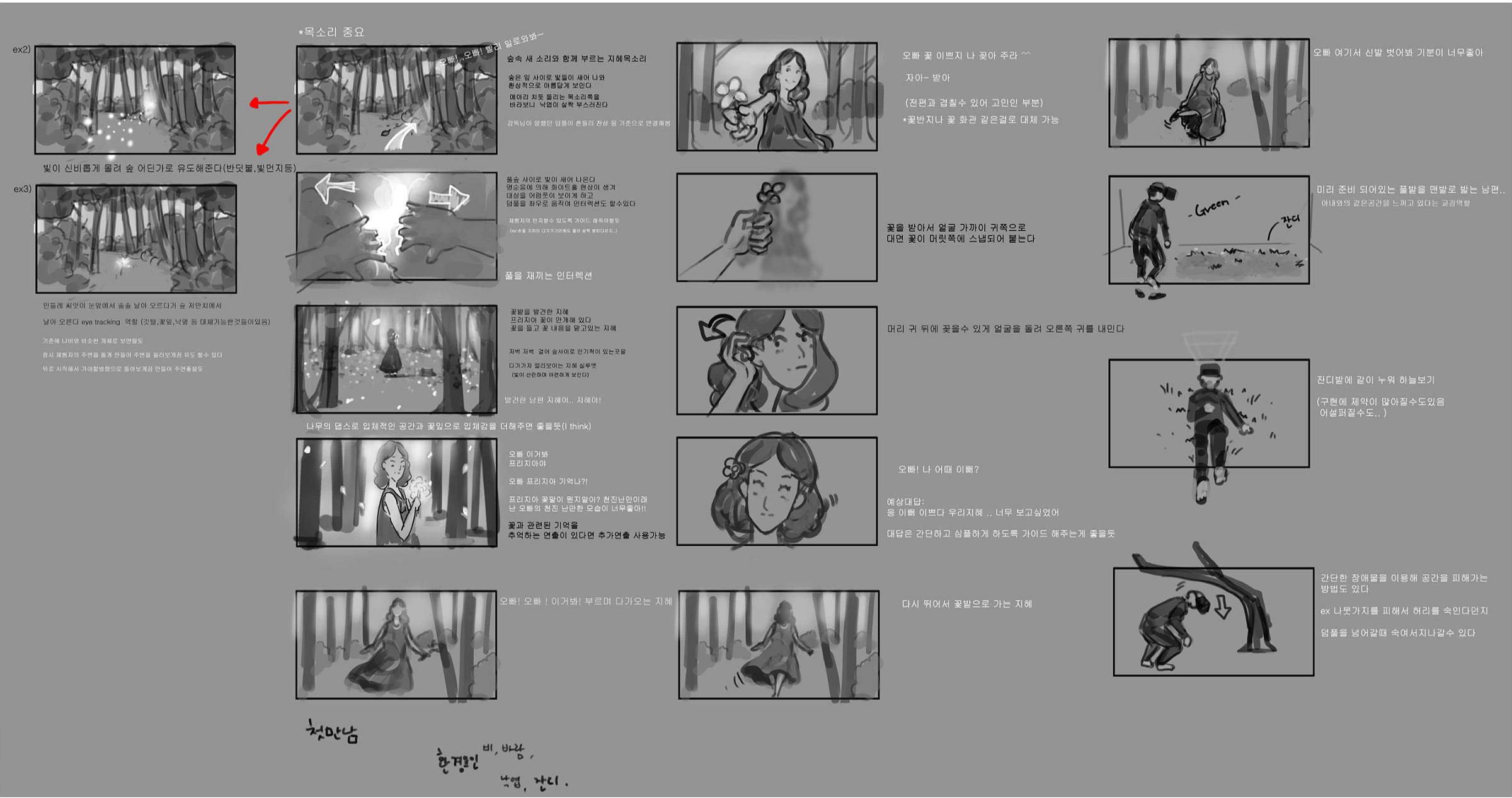

월정사 숲의 경우 연출진과 VFX 팀이 직접 월정사를 찾아 사진을 찍고 자료를 확보할 수 있었기 때문에 제작은 훨씬 수월했지만 나무와 수풀, 꽃들의 디테일을 표현하다 보니 VR에서 구동하기에는 충분한 퍼포먼스가 나오지 않았다. VR에서도 원활하게 돌아갈 퍼포먼스를 만들기 위해 라이팅과 어셋들의 최적화가 필요했다. 처음 지혜 씨와 남편분이 숲에 도착했을 때는 낮으로 시작해서 시간이 지남에 따라 반딧불이 나오는 밤에 마지막 이별을 나누는 스토리를 기획하다 보니 낮과 밤의 라이팅을 화면전환 없이 서서히 바꿔야 하는 문제도 있었다. 언리얼 엔진 같은 게임 엔진은 실시간으로 구동되는 퍼포먼스가 중요하기 때문에 라이팅을 베이크해서 텍스처에 미리 입히는 방식을 사용할 수밖에 없는데 태양의 역할을 하는 디렉셔널 라이트의 각도를 바꿀 경우 빌드된 텍스처가 깨져버리는 문제가 있었기 때문에 여러 가지 편법과 언리얼 엔진의 시퀀서를 이용해서 10분 동안 천천히 낮부터 밤으로 바뀌는 라이팅을 구현할 수 있었다.

캐릭터와 애니메이션의 제작

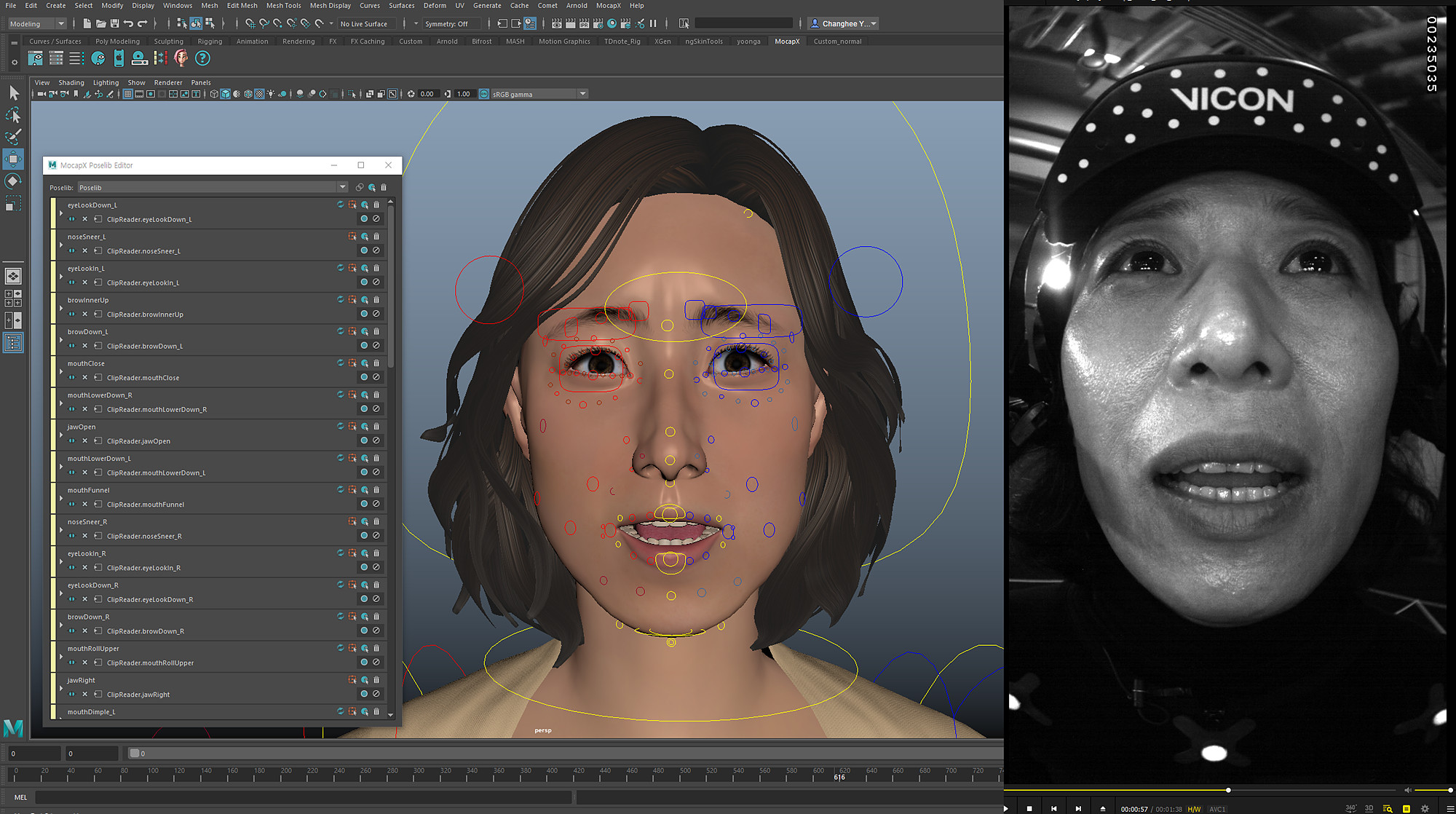

1편의 나연이와 달리 엄마였던 성지혜 씨는 본인의 사진이 거의 없었고, 지혜 씨가 출산과 암 투병으로 사진마다 몸무게 변화가 심했기 때문에 어느 시점을 기준으로 지혜 씨의 모습을 제작해야 하는지 여러 논의가 있었다. 언리얼 엔진 4.25버전에 헤어 기능이 추가되었지만 테스트 결과 VR 환경에서는 충분한 퍼포먼스가 나오지 않아 헤어시스템 대신 메터리얼을 이용할 수밖에 없었다. 마야와 블랜더 등 기존의 3D 프로그램에서는 괜찮아 보이는 헤어 메터리얼이 게임 엔진에서는 제대로 표현되지 않았기 때문에 추가적인 모델링 수정이 필요했지만 모델링을 수정할 경우 리깅부터 애니메이션 적용의 과정을 다시 거쳐야 했기 때문에 방송 스케줄상 포기할 수밖에 없었다.

모션캡처는 NC소프트의 모션캡처 스튜디오에서 이루어졌다. 연극배우 우미화 씨가 모션캡처 연기를 담당했다. 남편과의 재회, 부부의 춤 등 성인 여성의 감정을 표현해야 하는 쉽지 않은 작업이었지만 다행히 우미화 씨가 훌륭하게 연기해 주셔서 예상보다 빠르게 세션을 마칠 수 있었다.

내부의 테스트 결과 기존의 광학식 페이셜 캡처 방식이 아이폰의 트루뎁스 카메라를 이용한 결과물과 큰 차이가 없다는 결론을 내리고 애플의 ARKit을 이용해서 페이셜 애니메이션을 캡처했다. 모션캡처를 이용하면 손으로 키를 잡는 것보다는 빠르게 사실적인 움직임을 얻을 수 있지만, 손가락의 표현이나 입술 모양의 구현 등 자연스러운 캐릭터의 움직임을 위해서는 후반에 많은 시간을 투자해야 한다. <너를 만났다> 2편의 경우 1편의 두 배가 넘는 20분 이상의 애니메이션이 사용되어 자연스러운 표정과 동작을 손으로 다듬는 애니메이션 작업도 촬영 전날까지 타이트하게 작업해야만 했다.

제작된 모델링이 실제의 지혜 씨와 상당히 유사하게 표현되었기 때문에 한 달 정도만 리얼타임 엔진으로의 전환과 애니메이션을 다듬는 과정에 시간을 더 투자했다면 훨씬 자연스러운 캐릭터를 표현할 수 있었겠다는 아쉬움이 남는다.

VR/AR의 구현

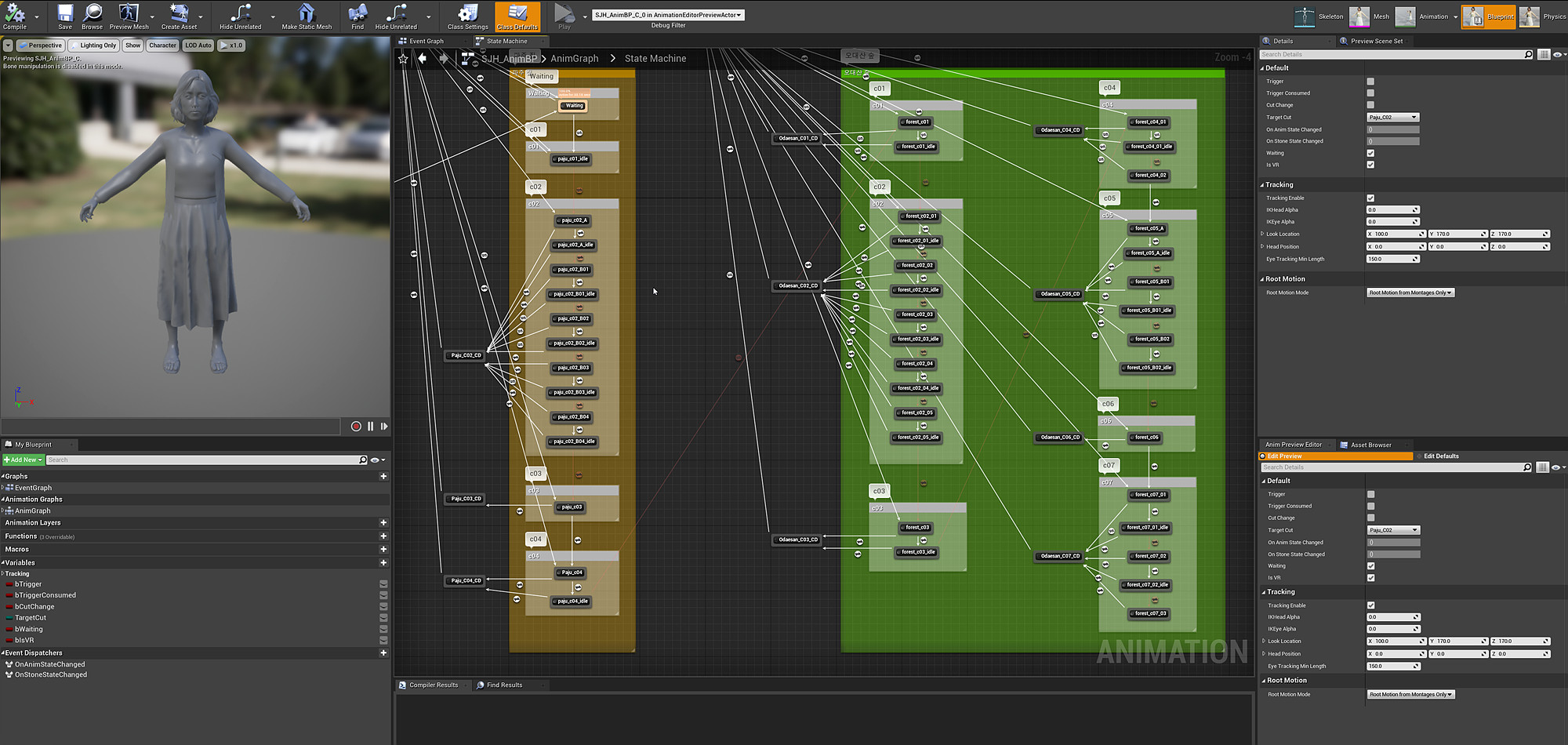

체험자가 시연공간의 중심에서 대부분의 체험을 했던 1편과 다르게 연출진은 체험자가 최대한 넓은 공간을 돌아다니면서 가상의 공간 속에 자연스럽게 빠져들기를 원했다. 아파트 현관과 부엌을 거쳐 거실에 도착하고 거실에서는 체험자가 지혜 씨와 거실을 돌면서 2분간 춤을 춘다. 오대산으로 공간이 전환된 후에는 오솔길을 걸어 돌탑과 벤치, 마지막 작별을 위한 꽃밭까지 상당히 넓은 공간을 복잡하게 돌아다니는 스토리를 구성했기 때문에 여러 가지 문제들이 발생했다. 실제로 촬영을 진행한 매직스튜디오의 공간을 거의 다 활용했기 때문에 VR 헤드셋이 헤드셋을 추적하는 레이저 센서의 범위를 벗어나 오작동을 일으키는 일이 빈번했다. 촬영에는 2대의 무빙 카메라와 3대의 고정 카메라가 사용되었는데, 카메라 한 대는 기존 매직스튜디오에서 사용하는 구형의 트래킹 시스템을 사용하고 다른 한 대는 핸드헬드로 찍을 수 있는 별도의 트래킹 솔루션을 사용했다. 넓은 시연공간과 트래킹 시스템의 한계 때문에 스튜디오 중앙에 기준을 맞추어도 외곽으로 갈수록 오차가 발생했다. 각각의 시스템이 갖는 오차 범위도 틀렸기 때문에 두 카메라 시스템 사이의 타협점을 찾아 돌탑과 벤치의 위치를 조정해야 했다.

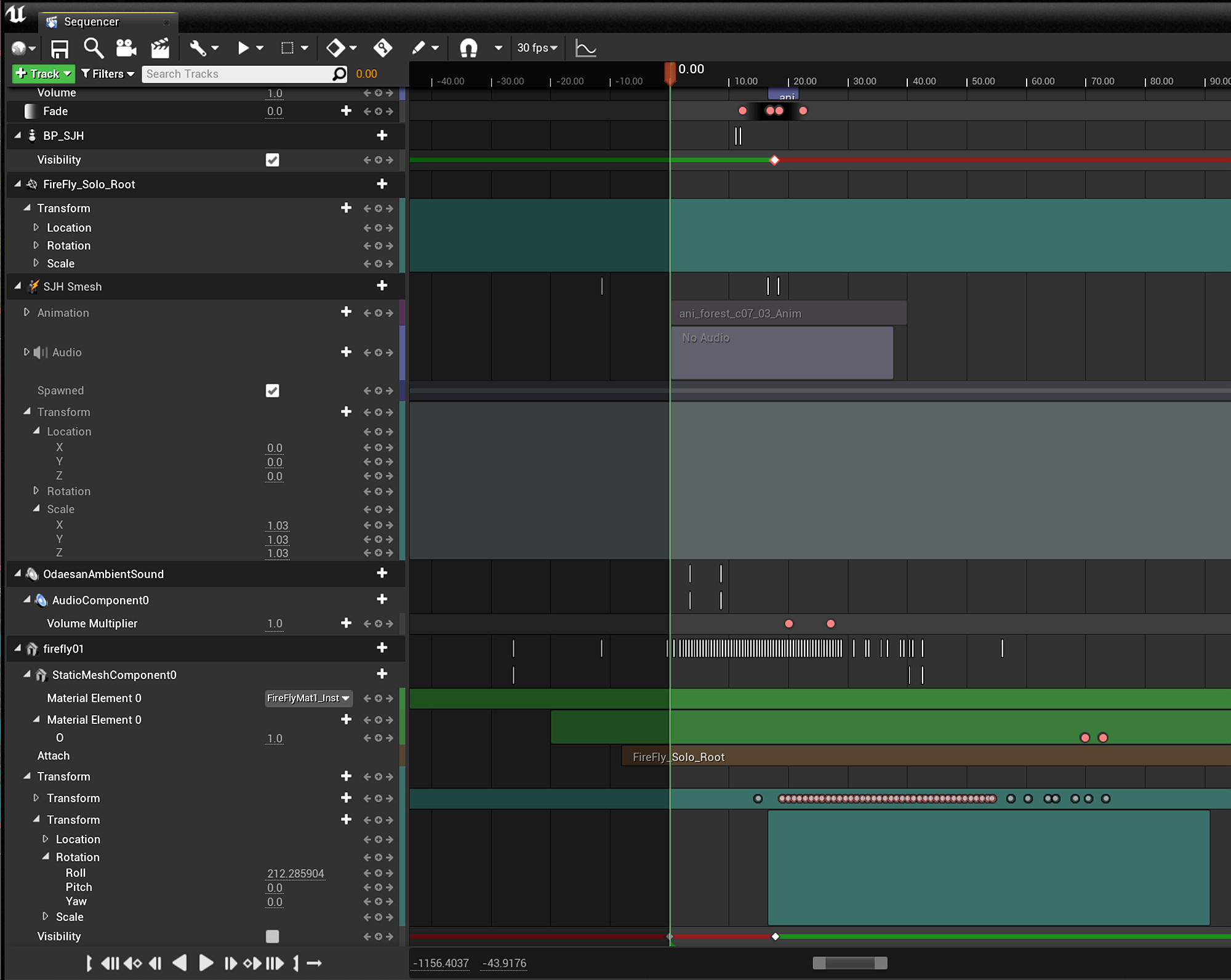

시퀀서는 언리얼 엔진 4.24.에서 정식 추가된 기능이다. 타임라인에 클립이나 샷들을 직관적으로 배치하고 애니메이션을 조정할 수 있어 이번 프로젝트에서는 시퀀서의 기능을 적극적으로 활용하였다. 앞에서 언급한 시간의 흐름에 따른 라이팅의 변화뿐 아니라, 바람이 갑자기 불어오는 부분에 사운드와 나무의 흔들림을 연동하고, 지혜 씨가 전등을 켤 때 애니메이션과 라이팅의 다양한 조절항목들을 같은 타임라인에 배치하고 동시에 조정함으로써 작업의 효율을 극적으로 높일 수 있었다.

시연에는 체험자가 착용할 VR 헤드셋과 연결된 컴퓨터 1대, 각각의 카메라와 제로덴서티를 통해 연동되는 2대의 컴퓨터가 필요했다. 체험자의 리액션에 따라 다음 이벤트로 넘어가는 시간을 수동으로 컨트롤할 수 있도록 다양한 idle 구간을 설정했기 때문에 VR 헤드셋과 연동된 컴퓨터에서 내린 명령이 동시에 다른 2대의 컴퓨터에 전달되게 프로그램되었는데, 리허설에서는 잘 작동하던 프로그램이 시연 당일에 갑자기 딜레이가 생기거나 명령 자체가 스킵되는 문제가 발생했다. 결국, 시연 중에 3대의 컴퓨터의 이벤트가 정확히 동기화되지 못한 채 진행되고 말았다. 다행히 정수 씨는 에러 없이 온전한 체험을 마칠 수 있었지만 카메라와 연동된 다른 컴퓨터에서는 정수 씨가 체험한 타이밍과 다른 이벤트들이 진행되기도 했기 때문에 후반에서 재합성을 하는 웃지 못할 일도 벌어졌다.

지혜 씨의 캐릭터가 자연스럽게 체험자의 VR 헤드셋에 눈을 맞출 수 있도록 언리얼 엔진의 블루프린트를 이용해서 시스템을 구축했지만 체험자의 이동이 워낙 많았기 때문에 체험자의 위치에 따라 목이 너무 돌아가거나 눈동자가 비정상적으로 돌아가는 문제도 있었다. 체험구간에 따라 기능을 온·오프 하거나 헤드와 눈동자의 범위에 리미트를 걸어 문제 발생을 최소화했다. 이런 기능들은 체험자의 VR 화면에서는 제대로 작동했지만 다른 2대의 컴퓨터와는 연동되지 않았기 때문에 카메라로 촬영한 영상에서는 디지털 캐릭터의 자연스러운 움직임이 표현되지 못했다.

부부의 춤, 돌탑 쌓기, 불씨 피우기 등 콘텐츠가 상당히 복잡하고 정수 씨가 한 번도 VR 경험을 해본 적이 없었기 때문에 시연 일에는 모두가 엄청난 긴장 상태로 시연을 지켜보았다. 다행히 20분이 넘는 시연을 준비한 대로 마칠 수 있었고 눈물을 흘리는 정수 씨와 아이들을 보면서 제작진 모두 함께 마음 아파했다.

기술의 미래

김종우 피디와 처음 <너를 만났다>의 아이디어를 갖고 만났을 때, 김종우 피디는 고인을 기억하는 새로운 방법으로 VR과 AR을 활용할 방법을 찾고 있었다. 사진도 존재하지 않던 우리 할머니 시절에는 고인이 쓴 편지가, 이후에는 사진과 비디오를 보면서 고인을 그리워했다면 이제 새로운 시대에는 VR과 AR이라는 새로운 기술로 고인을 추억할 수 있지 않을까? 김종우 피디의 비전은 3편의 다큐멘터리를 통해서 실현되었고 그것이 옳고 그름을 떠나 VR/AR의 기술이 가져올 새로운 미래를 조금이나마 엿볼 수 있는 시간이었다고 생각한다.

언리얼 엔진을 개발한 에픽게임즈가 올해 선보일 메타휴먼스 프로젝트나 얼마 전 논란이 되었던 스캐터랩의 ‘이루다’ 같은 인공지능 챗봇 등의 기술이 결합된다면 당장 올해 안으로 지금보다 훨씬 자연스럽고 인간처럼 반응하는 디지털 휴먼을 만들어 낼 수 있을 것이다. 신기술이 하루가 다르게 쏟아져 나오는 이 시기에 우리는 어떻게 새로운 기술들을 활용할 것인지 많은 고민이 필요할 것 같다.

작업을 위해 여러 개의 프로젝트를 동시에 진행하며 수개월 동안 밤낮으로 고생한 MBC VFX 팀원들과 외부업체의 팀원분들, 시연을 위해 맘 졸이며 최선을 다해주신 기술 감독님들과 카메라 감독님들에게 감사드린다. 무엇보다 김정수 씨와 다섯 아이가 이 경험을 통해 조금이나마 엄마의 상실을 극복할 수 있기를, 그리고 하늘에 계신 지혜 씨가 행복하기를 바란다.