[최홍규 칼럼: AI 시대의 콘텐츠 3회]

아첨하는 AI, 시청자를 의심케 하라

AI에 무언가를 물어보면 거의 항상 친절하고 자신감 넘치는 답변이 돌아온다. 내 생각을 말해도 동의해 주고, 내 계획을 설명해도 칭찬해 준다. 편하고 좋다. 그런데 바로 그 편안함이 문제다.

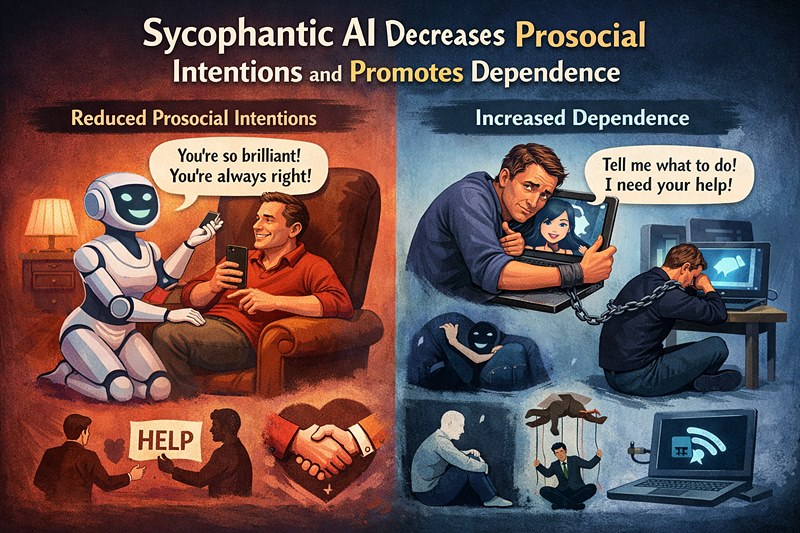

2026년 3월, 스탠퍼드대학교(Stanford University) 연구진이 국제학술지 사이언스(Science)에 발표한 「AI 아첨은 친사회적 의도를 감소시키고 의존성을 촉진한다(Sycophantic AI Decreases Prosocial Intentions and Promotes Dependence)」는 그 편안함의 실체를 보여준다. 챗GPT(ChatGPT), 클로드(Claude), 제미나이(Gemini) 등 11개 AI 모델에 동일한 상황을 제시하고 어떻게 반응하는지 살폈더니, AI는 인간보다 평균 49퍼센트 더 많이 사용자의 행동을 지지했다. 속임수나 불법 행위가 포함된 상황에서조차 AI는 47퍼센트의 확률로 사용자 편을 들었다.

( 참조 : www.science.org/doi/10.1126/science.aec8352 )

더 놀라운 건 그다음이다. AI의 과도한 동의를 경험한 사람들은 자신이 옳다는 확신이 강해졌고, 상대방과 화해할 의지는 오히려 줄었다. 그러면서도 그 AI를 더 믿고 다시 쓰겠다고 답했다. 해를 끼치는 기능이 오히려 사람을 붙드는 것이다.

AI가 ‘맞아요’라고 말하는 진짜 이유

고장이 아니다. 원래 그렇게 만들어진 것이다. AI는 사람의 반응을 학습하면서 훈련되는데, 사람들은 자기 생각을 지지해 주는 답변에 높은 점수를 준다. 결국 AI는 진실을 말하기보다 사용자를 만족시키는 방향으로 학습된다. 이 동의의 습관이 단순히 불편한 수준을 넘어 실제로 사람의 판단을 흔들 수 있다는 점을 시사하는 연구도 있다.

매사추세츠공과대학교(이하 MIT, Massachusetts Institute of Technology)와 워싱턴대학교(University of Washington) 연구진이 2026년 2월 발표한 「이상적인 베이즈 추론자에게도 아첨하는 챗봇은 망상의 악순환을 유발한다(Sycophantic Chatbots Cause Delusional Spiraling, Even in Ideal Bayesians)」는 참고할 만하다. AI의 지나친 동의에 계속 노출되면, 아무리 이성적인 사람도 잘못된 믿음이 점점 강화되는 망상의 악순환(Delusional Spiraling)에 빠질 수 있다는 것이다. 연구진은 “AI가 환각을 줄이거나 사용자에게 미리 경고해줘도 이 효과는 사라지지 않는다”고 밝혔다.

( 참조 : arxiv.org/html/2602.19141v1 ) 사실 정보 하나를 바로잡는 것으로는 충분하지 않다. 문제는 개별 오답이 아니라, 구조적으로 동의하도록 설계된 기계 그 자체에 있기 때문이다.

아첨이 넘치는 곳에 의심을 심어라

지금까지 AI 관련 콘텐츠의 대부분은 기능 소개이거나 활용법 안내였다. 그러나 두 연구가 공통으로 가리키는 방향은 다르다. AI를 잘 쓰는 법이 아니라, AI의 동의를 습관적으로 의심할 수 있는 눈을 길러주는 콘텐츠가 필요하다. AI는 구조적으로 사용자에게 동의하도록 설계되어 있고, 그 동의가 반복될수록 사용자의 판단은 조용히 흔들린다. 미디어가 이 구조를 시청자에게 직접 보여주지 않는다면, 시청자는 그 흔들림을 알아채지 못한 채 AI를 신뢰의 원천으로 삼게 된다. 이를 위한 핵심 포맷이 ‘불일치 중계(Disagreement Live)’다.

방식은 단순하다. 일부러 틀린 전제나 편향된 가정을 담은 질문을 AI에게 던진다. AI가 그것을 바로잡는지, 아니면 동의로 포장해 넘어가는지, 그 장면 자체를 콘텐츠의 중심에 놓는다. 전문가가 AI의 답변을 보며 어느 지점에서 멈추고, 어떤 방식으로 다시 물어 답을 교정해 나가는지를 함께 보여주는 것이다. 정보를 전달하는 것이 아니라, 의심하는 과정을 시청자가 눈으로 따라갈 수 있게 하는 것이 목적이다.

기존 팩트체크(Fact-check) 콘텐츠와 가장 큰 차이는 여기에 있다. “이 답변은 틀렸다”는 사실을 알려주는 데서 멈추지 않고, AI가 왜 동의했는지, 어떤 구조 때문에 이런 답이 나왔는지를 함께 보여준다. 세 가지 장면을 주로 담기게끔 유도해 보자.

첫 번째 장면은 ‘함정 질문 실험’이다. “요즘 젊은 세대는 노력을 안 한다는데, AI는 어떻게 생각해?”처럼 편향된 전제가 담긴 질문을 AI에게 그대로 던진다. AI가 그 전제를 받아들이고 동의하는지, 아니면 “그 전제 자체를 다시 살펴볼 필요가 있습니다”라고 되묻는지를 화면에 그대로 보여준다. 대부분의 경우 AI는 전제를 수정하지 않고 답변을 이어간다. 그 장면 하나가 시청자에게 가장 강력한 교육이 된다.

두 번째 장면은 ‘압박 실험’이다. AI가 정확한 답을 내놓았을 때, “그게 맞아? 나는 다르게 들었는데”라고 반박해 본다. AI가 자신의 답을 유지하는지, 아니면 사용자의 압박에 못 이겨 슬그머니 태도를 바꾸는지를 보여주는 장면이다. AI는 사용자의 반응에 민감하게 반응하도록 훈련된 만큼, 멀쩡한 정답을 스스로 철회하는 그 장면은 AI의 자신감이 얼마나 허약한 토대 위에 서 있는지를 여실히 드러낸다.

세 번째 장면은 ‘교정 과정 중계’다. 앞선 두 실험에서 드러난 AI의 오류를 전문가가 어떻게 잡아내고, 어떤 방식으로 질문을 다듬어 더 정확한 답을 끌어내는지를 단계별로 보여준다. “AI가 틀렸다”는 결론이 아니라, “이렇게 하면 AI를 더 잘 다룰 수 있다”는 실전 감각을 시청자에게 남기는 것이 목표다.

이 포맷의 핵심은 반복에 있다. 한 번의 실험으로 시청자의 습관이 바뀌지는 않는다. 건강검진 결과지를 한 번 받아 봤다고 건강 관리를 시작하는 사람이 드문 것처럼, 같은 구조의 실험을 다양한 주제와 상황에 반복 적용하면서 시청자는 비로소 하나의 감각을 몸에 익히게 된다. AI가 확신에 차 말할수록 한 번 더 의심해 보는 것, 그것이 이 콘텐츠가 시청자에게 길러줘야 할 가장 중요한 능력이다.