1. NHK 기연공개(Open House) 소개

NHK 방송기술연구소에서는 매년 방송기술 연구성과를 정리해 업계 종사자 및 일반인에게 공개하는 ‘기연공개(Open House)’ 행사를 개최하고 있습니다. 올해는 ‘틀에서 벗어나라, 미래의 미디어(ワクからはみ出せ、未来のメディア)’라는 주제로 TV를 시청하는 방식이 변화하는 최근 트렌드를 반영하고, 2030~2040년의 미래 TV 시청행태를 가늠해볼 수 있는 전시회를 마련했습니다. 올해 주제인 ‘틀에서 벗어나라, 미래의 미디어’처럼, TV를 더 이상 네모난 ‘틀’에 가두지 않고 표현 공간이 확장된 차원으로 다뤄보겠다는 의지를 살펴볼 수 있었습니다.

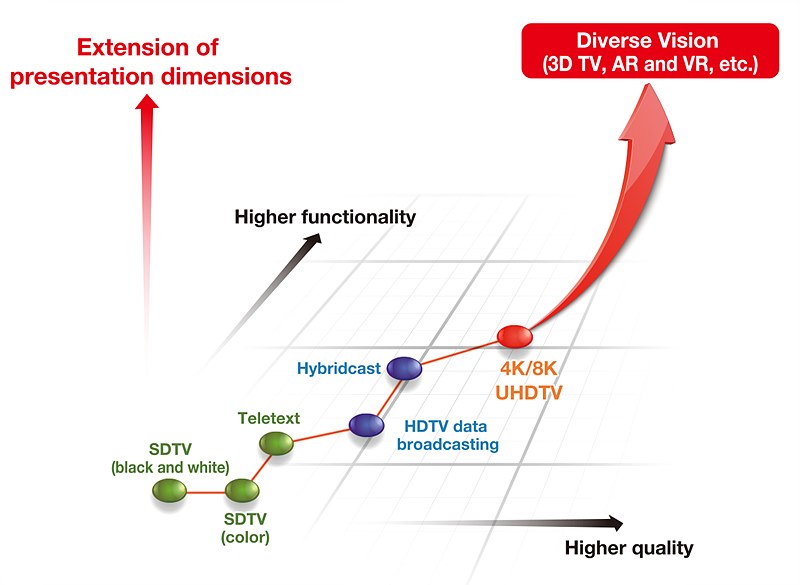

‘다양한 시청스타일을 실현하는 미디어 기술’이라는 개념의 ‘다이버스 비전(Diverse Vision)’은 작년 기연공개 2018의 전시 제목이기도 했습니다. 올해는 크게 네 개의 카테고리로 전시를 구분했으며, 각각 Interactive Exhibit, Reality Imaging, Smart Production, Connected Media, 마지막으로 기타 주제가 있었습니다. 전시는 3D, AR, VR를 통한 새로운 시청 경험을 제공하는 기술은 물론, 방송 서비스의 편리성을 더욱 높일 인터넷 활용 기술, AI를 이용해 효율적으로 프로그램을 제작하는 기술, 그리고 장애인을 위한 보편적 서비스 등 약 25개 항목의 연구성과를 직접 체험해볼 수 있도록 마련되었습니다. 특히 Reality Imaging 주제에 절반이 넘는 전시를 선보이는 등 8K, 3D, AR/VR에 주력한 모습이었습니다.

2. NHK 기연공개 2019에서 선보인 주요 연구 내용

1) Rreality Imaging – 현실감과 몰입감을 높인 콘텐츠 서비스

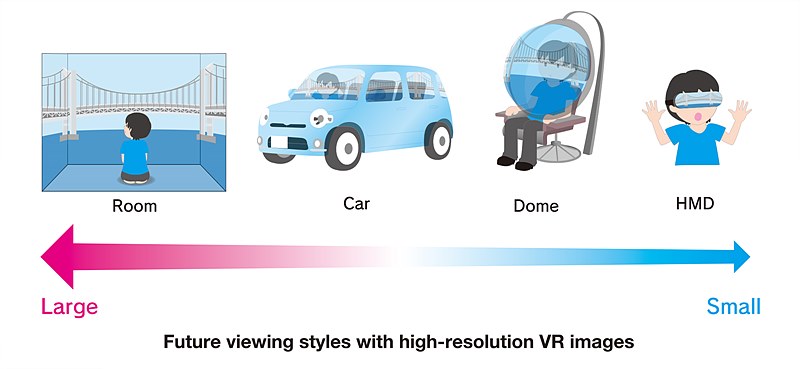

NHK 방송기술연구소는 미래의 영상 콘텐츠 시청은 TV를 넘어 Diverse Vision – 거실 공간을 가득 채운 화면이나, 자율주행 시대에 자동차 내부에서의 VR 시청, 완전한 돔(Dome)이나 가장 작게는 HMD(Head Mount Display)까지 – 다양한 시청 스타일에 대응할 수 있도록 8K 카메라 여러 대를 이용한 촬영, 4K 프로젝터의 개발 등 VR용 고해상도 이미지 연구를 수행하고 있습니다.

이번 기연공개 2019에서는 초대형 곡선형 스크린을 통해 오케스트라의 연주를 상영하거나, 다채널 서라운드 오디오와 AR, VR 시청이 가능한 미래형 디스플레이를 선보이기도 했습니다. 현실 재현도가 높은 고화질 VR 이미지를 즐길 수 있는 날이 머지않아 보입니다.

② AR을 활용한 TV 시청 스타일의 변화

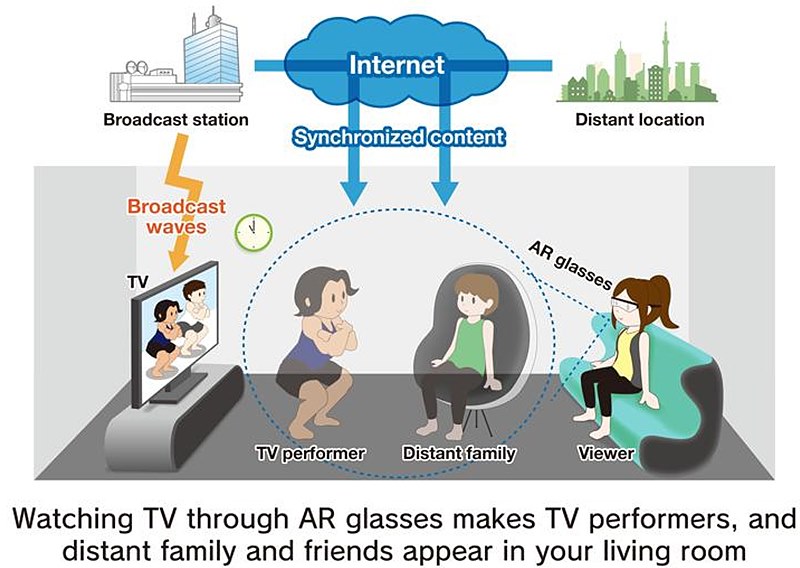

리얼리티 이미징 부스에서는 기존 TV의 테두리를 넘은 새로운 콘텐츠의 세계로서 AR을 활용한 TV 시청스타일을 선보이기도 했습니다. 멀리 떨어져 있는 가족이나 친구들이 바로 옆에 있는 것처럼 함께 TV를 시청하거나(공간 공유서비스), AR 고글을 쓰면 TV 속 출연자가 ‘TV 밖으로 나와’ 바로 내 옆에서 3차원의 실물 크기로 합성되는 영상기술들입니다(TV 영상과 실사 AR 동기화).

AR 고글을 쓰면 볼 수 있는 실물 크기로 구현된 3D 출연자(우)

지금까지 TV를 본다는 것은 TV나 스마트폰 등 매체만 달라질 뿐 ‘스크린을 바라본다’는 개념이었습니다. 하지만 기연공개 2019에서는 NHK의 인기 프로그램 ‘모두 근육체조(みんなで筋肉体操)’의 출연자인 다케다 신지(武田真治)를 AR 실사로 구현하고 이를 동기화해, AR 고글을 착용한 뒤 바로 옆에서 함께 운동할 수 있는 데모 프로그램으로 만들어 전시했습니다. 그야말로 TV 밖으로 튀어나온 출연자와 무엇인가를 함께 할 수 있는 기술을 구현함으로써 TV 시청공간의 확장을 이뤄낸 셈입니다.

TV 출연자의 3D 이미지는 TV 방송 프로그램과 함께 ‘인터넷’을 통해 실시간으로 전송되기 때문에 동기화하는 것이 가능합니다. MMT(MPEG Media Transport) 기술을 사용해 이미지에 공통 타임스탬프를 추가함으로써 수신 측에서는 자유시점 AR 및 TV의 동기화된 화면을 볼 수 있게 됩니다. MMT는 5G 시대의 차세대 영상 전송기술로 주목받고 있기도 합니다.

2) Connected Media – 인터넷을 활용한 이용자 경험의 확장

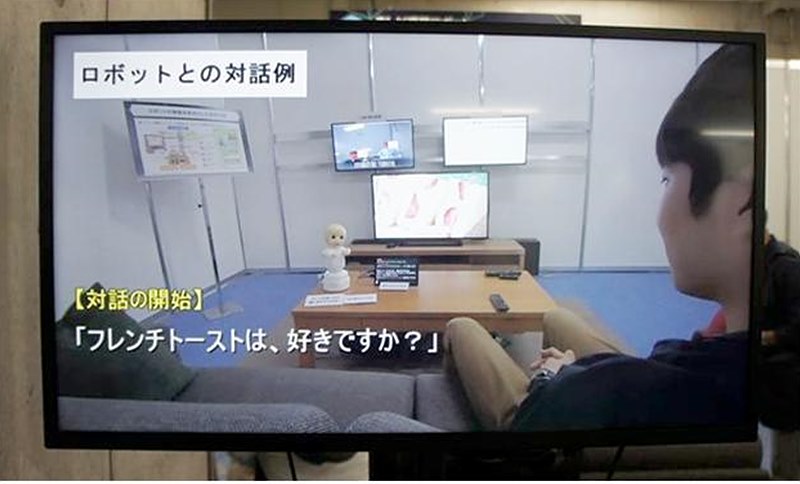

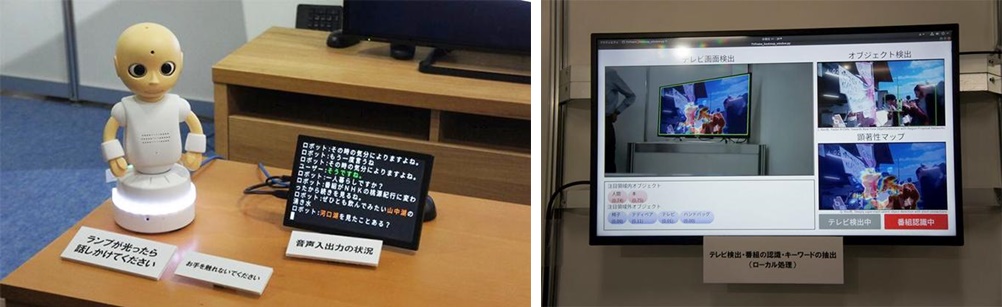

이번 전시의 두 번째 카테고리로 ‘커넥티드 미디어’가 있었습니다. 이 주제에서는 ‘TV 시청 동반자 로봇(TV-watching Companion Robot, 이하 TV 로봇)’을 소개합니다. TV 로봇은 시청자가 TV를 보며 친한 친구처럼 가볍게 대화할 수 있는 ‘차세대 휴먼-컴퓨터 상호작용 로봇’입니다. 2017년부터 기연공개를 통해 선보인 주제로, 해마다 향상된 연구 결과를 보여주고 있습니다. 핵심은 TV 프로그램의 비디오 및 오디오에서 키워드를 추출하고 이와 관련된 발언을 감정을 포함한 문장으로 구현한다는 점입니다. ‘현재 시청 중인 프로그램’의 내용을 토대로 ‘감정’을 표현한다는 점에서 현재의 단순 낭독형 AI 스피커와는 분명히 구분됩니다. 참고로 연구진이 로봇 자체를 개발한 것은 아니고 상업용 로봇 ‘commU’에 TV 로봇으로서 작동할 수 있는 다양한 기능을 탑재한 것입니다.

NHK 방송기술연구소에서 발행하는 <Broadcast Technology> 71호에서는 TV 시청 로봇을 구현하는 기술을 크게 세 가지로 구분하고 있습니다. 첫째 로봇 주변의 사람과 텔레비전을 감지하는 기술, 둘째 프로그램과 관련된 음성을 생성하는 기술, 마지막으로 로봇 작동을 제어하는 기능을 포함하여 로봇이 TV를 시청하는 데 필요한 기본 기능입니다.

TV 로봇에는 카메라와 마이크가 있어 시청자의 얼굴 및 음성을 인식해 위치를 감지합니다. 또 TV 화면 또는 비디오의 특성을 파악해 TV의 위치도 감지합니다. 다음으로 시청 중인 프로그램의 화면을 인식해 이를 토대로 자막 키워드를 추출하고, 미리 구성된 템플릿에 해당 키워드를 조합하는 방식으로 발화문을 생성합니다. AI 학습에 의해 화면의 정보를 분석하는 동시에 텔레비전 EPG 등의 프로그램 정보 등을 추가해 대화에 활용합니다. 예를 들어, ‘나는 …을 먹고 싶다’ 또는 ‘나는 …에 가고 싶다’와 같은 템플릿에 현재 방송 중인 프로그램과 관련된 키워드를 넣어 만드는 방식입니다. 대화를 하며 몸이나 팔을 움직이는 등 간단한 제스처를 통해서도 시청자와 상호작용할 수 있습니다.

이렇게 만들어진 TV 로봇과의 대화를 통해 혼자 TV를 시청하더라도 좀 더 재미있고 즐겁게 TV를 시청할 수 있을 것으로 예상됩니다. 핵 가구를 넘어 1인 가구가 증가하는 라이프 스타일에 맞춰 TV 로봇은 가족이나 친구의 빈자리를 채워줄 것으로 예상됩니다.

3) Smart Production – AI를 활용한 보다 효율적인 프로그램 제작

① 스포츠 중계를 위한 AI 카메라 시스템

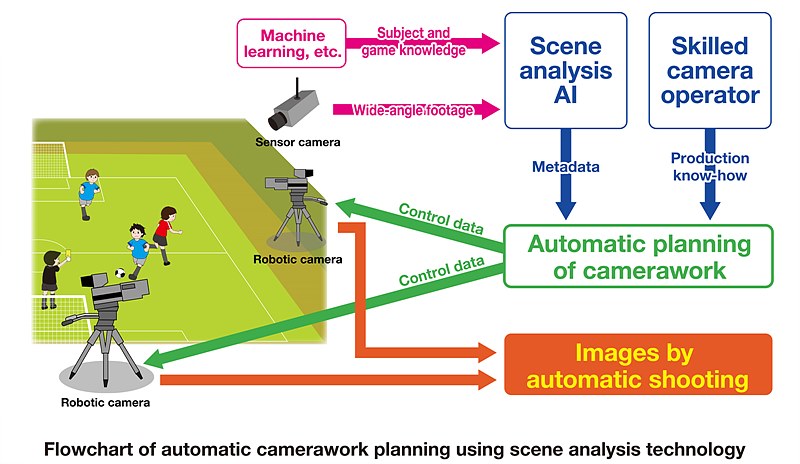

세 번째 큰 카테고리는 ‘스마트 프로덕션’입니다. 이 주제에서는 2020년 도쿄올림픽을 앞두고 마련된 스포츠 관련 방송기술 연구 결과가 많이 전시되었는데, 본 고에서는 효율적인 스포츠 중계를 위한 ‘AI 기반의 자동화된 카메라워크’를 소개합니다. 이 연구는 IMAGICA LIVE 및 J리그 미디어 프로모션과의 협업으로 이뤄지고 있습니다.

이 시스템은 우선 경기장 전체를 조감할 수 있는 8K 카메라 1대를 ‘Sensor 카메라’로 두어 선수와 볼의 위치, 속도, 선수의 얼굴 방향 등 축구경기의 장면 정보를 메타데이터로써 수집하고, 쉽게 추출할 수 있도록 합니다. 한편에서는 숙련된 스포츠 중계 제작자의 노하우를 입력합니다. 이러한 메타데이터와 노하우를 바탕으로 적절한 프레이밍을 자동으로 결정하는 ‘자동카메라 워크’ 로직을 개발하고, 이를 다시 경기장 곳곳에 있는 무인카메라에 전달해 자동으로 컨트롤할 수 있게 합니다. 일련의 과정은 장르만 다를 뿐 지난 5월호에서 소개했던 BBC의 AI 기반 영상 제작 방식과 유사함을 알 수 있습니다.

② 날씨 정보를 전달하는 AI 아나운서

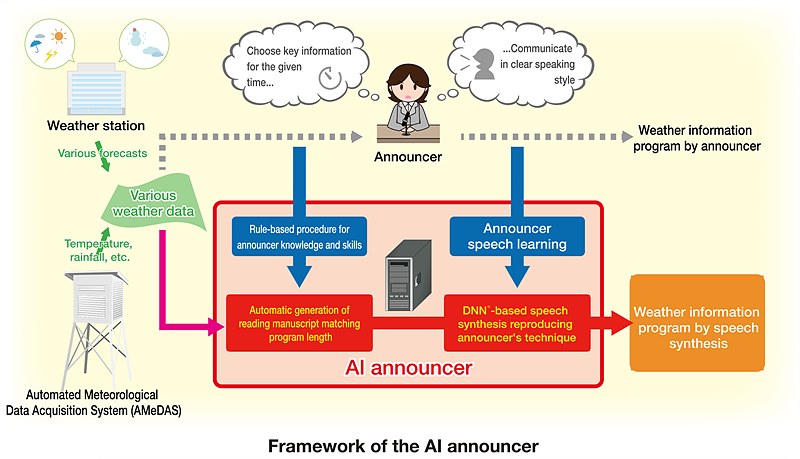

지난 7월호에서 NHK AI 아나운서 ‘요미코’를 소개해드린 바와 같이, NHK에서는 꾸준히 인간의 목소리를 닮은 합성음성을 개발하는 것과 함께, 기존의 뉴스 스크립트를 활용한 ‘자동 뉴스 스크립트 생성 시스템 연구’를 수행하고 있습니다. 기연공개 2019에서는 라디오를 통해 기상정보를 전달하는 AI 아나운서의 개발 과정을 소개했습니다.

AI 기반의 라디오 일기예보 뉴스 생산은 인간 아나운서가 하는 업무를 자동화하는 방식으로 개발했습니다. AI 아나운서 역시 정보의 우선순위를 정하고, 정해진 방송시간에 맞춰 다양한 데이터를 토대로 스크립트를 작성합니다. 이 과정은 규칙기반 절차에 기반, 컴퓨터로 자동화되어 방송시간에 맞춘 적절한 스크립트를 생산합니다. 또한 합성음성을 통해 NHK 아나운서와 같은 뉴스 스피치를 재현합니다. DNN 기반의 합성음성 기술을 사용해 자연스러운 억양 및 끊어 읽기(pause)를 구현합니다.

4) 유니버셜 서비스

① 일기예보에서 스포츠 중계까지 – 수화 CG

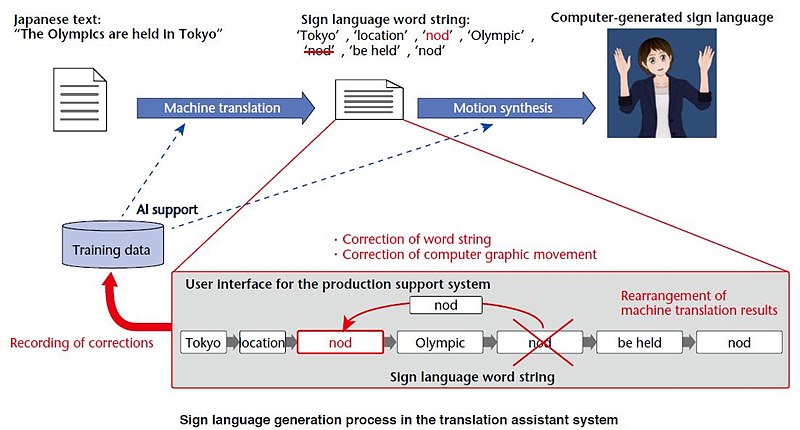

한편, NHK 방송기술연구소는 청각장애인에 대한 방송 서비스 확충을 위해 ‘수화 CG’를 개발하고 있습니다. 수화 CG의 연구 목적은 방송 자막만으로는 내용을 완전히 이해하기 어려운 청각장애인을 위해 보조적인 추가 서비스를 제공하고, 비상사태 및 재해정보 뉴스 속보에 자동으로 수화 CG 생성해 빠르게 뉴스를 전달하기 위함입니다. 실제 수화를 CG 애니메이션으로 구현하는 것이 첫 번째 단계였다면, 현재는 자막 또는 음성 데이터를 통해 자동으로 수화 CG를 생성하는 것을 목표로 하고 있습니다.

이러한 지속적인 연구의 성과로, 최근에는 기상청의 날씨 데이터를 받아 자동으로 일기예보를 생성·전달하는 수화 CG 서비스를 개발했습니다. 이 서비스는 기상청이 정기적으로 보내는 XML 데이터에 기초하여 기상 예측을 위해 준비된 수화 템플릿을 사용합니다. 연구진은 생성된 수화 CG가 청각장애인이 이해하는데 무리가 없는지 테스트하는 등 수화 효과와 품질을 높이기 위해 노력했습니다. 현재 NHK 기상정보 수화 CG 홈페이지를 통해 1일 3회(5시, 11시, 17시) 도쿄 등 일부 지역의 수화 CG 일기예보를 볼 수 있습니다. 보다 향상된 기능을 제공하기 위해 이용자들로부터 계속해서 피드백을 받고 있습니다. ‘기상정보 수화 CG’는 다음 URL을 통해 확인할 수 있습니다. (www.nhk.or.jp/strl/sl-weather/index.html)

여기서 더 나아가 연구진은 일기예보에만 적용했던 수화 CG를 스포츠 프로그램에도 적용할 수 있는 연구를 진행하고 있습니다. 청각장애인에게 스포츠 뉴스 시청의 즐거움을 전달하고, 경기 정보를 ‘자동으로’ 빠르게 전달하기 위한 목적입니다. 일정한 템플릿에 수치 데이터만 바꾸면 되는 일기예보와 달리, 스포츠 뉴스나 경기는 완전한 문장을 구사해야 하기 때문에 일본어를 보정하는 단계가 필요합니다. 연구진은 오류가 있는 문장에서 수화 단어를 자동으로 재배치하거나 수정을 용이하게 하는 사용자 인터페이스를 개발했습니다. 또한 트레이닝 목적으로 사용하는 데이터의 경우, 보정 이력을 저장하거나 템플릿으로 재사용해 일본어를 수화 CG로 전환하는 과정에서의 정확성을 높이는 데 활용하고 있습니다.

연구진은 교육 데이터의 양이 증가함에 따라 향후 수화 CG 생산 효율성이 점차 높아질 것으로 기대하고 있습니다. 앞으로는 스포츠 뉴스 프로그램에 대한 테스트를 실시하고, 수화 CG를 일반 뉴스 프로그램으로까지 확장할 계획을 가지고 있습니다.

② 스포츠 경기의 감동, 청각을 넘어 촉각으로 전달하기

한편, NHK는 도쿄올림픽을 앞두고 2017년부터 스포츠 중계 감각연구를 수행해왔습니다. 우선 작년에는 기본 오디오 정보에 더하여 스포츠 경기의 시각적 정보를 음성해설로 추가·보완하는 기술연구를 추진했습니다. 이러한 연구 결과, 실시간 스포츠 경기 데이터를 받아 자동으로 오디오 스크립트를 생성하며, 이를 그대로 실시간 자막 방송에 사용하거나 실제 아나운서처럼 자연스럽게 스크립트를 읽을 수 있는 시스템이 개발되었습니다. 이처럼 작년에는 시각장애인을 위한 스포츠 중계 서비스를 선보였다면, 올해 기연공개 전시에서는 청각장애인을 위한, 촉각을 통한 시청 경험의 확장을 이뤄낸 연구 결과를 선보였습니다.

사진은 스포츠 경기의 감동을 공유하고 즐길 수 있는 보편적 서비스로서 청각장애인이 경기를 보다 생생하게 체감할 수 있도록 개발된 촉각 인터페이스 체험 장면입니다. 구기 종목에서 서브, 리시브 등이 이뤄질 때 공의 궤적, 힘의 방향, 크기 등을 추정하고, 이를 사진 속 노란 구형 장치를 통해 진동으로 느낄 수 있도록 했습니다. 또 경기 중 공이 벽이나 바닥에 맞았을 때의 소리나 높낮이 또한 진동으로 느낄 수 있도록 했습니다. 이러한 기술을 이용해 시청각 장애인도 경기 상황과 현장감을 보다 생생하고 직감적으로 느낄 수 있는 것은 물론, 고령화 시대에 건강이 좋지 않은 사람도 스포츠경기를 즐길 수 있을 것으로 보입니다.

3. 미래의 시청자를 사로잡을 장기적 연구계획의 필요성

NHK 방송기술연구소는 2018년부터 2020년까지의 3개년 연구주제를 Reality Imaging, Connected Media, Smart Production으로 구분하고 있습니다. 이번 호에서 살펴본 기연공개 2019의 내용은 단기적으로 끝나는 것이 아닌, 장기적인 연구 흐름 중 일부가 되는 것입니다. NHK 방송기술연구소의 이러한 계획과 연구성과는 방송기술의 영역을 영상의 고품질·고기능화에만 한정하지 않고, 시대 변화에 따라 새로운 표현 공간을 탐구하고 콘텐츠의 영역을 확장하고 있는 것으로 보여집니다. 과거의 기연공개 리스트를 살펴보면 비슷한 주제가 중복됨에도 불구하고 지난해의 연구 결과를 더 발전시키거나 체험 가능한 결과물로서 만들어내는 등 매년 새로운 결과를 선보이고 있습니다. 이렇게 한 가지 주제를 수년간 지속해서 연구·개발하는 NHK 방송기술연구소의 특징이라고 볼 수 있겠습니다. 국내에도 다년간의 방송기술 연구 결과를 축적하는 것은 물론, 변화한 라이프 스타일에 맞춰 시청자를 사로잡을 수 있는 장기적 관점의 방송기술 연구가 이뤄지길 바랍니다.